Le Data Mesh est souvent présenté comme la réponse moderne aux limites des architectures data centralisées. Promesse de scalabilité, responsabilisation des métiers et accélération des usages analytiques et IA, le modèle séduit de nombreux groupes internationaux. Pourtant, derrière la clarté apparente des principes, sa mise en œuvre implique une transformation organisationnelle profonde, bien au-delà d’un simple choix d’architecture technique. Cet article propose une lecture stratégique et pragmatique du Data Mesh : son origine, ses apports réels, ses risques souvent sous-estimés et les conditions concrètes pour en faire un levier de performance plutôt qu’un facteur de complexité.

.png)

Le Data Mesh est devenu en quelques années un concept central dans les discussions autour des architectures data modernes. Présenté comme une alternative aux modèles centralisés traditionnels, il promet scalabilité, responsabilisation des métiers et accélération des usages analytiques et IA. Sur le papier, la proposition est particulièrement séduisante. Dans la réalité des grandes organisations, elle s’avère nettement plus exigeante.

Cet article propose une lecture complète et pragmatique du Data Mesh : son origine, ses principes fondateurs, ses apports théoriques, ses limites opérationnelles et les conditions réelles de succès.

Le concept a été introduit en 2019 par Zhamak Dehghani, alors qu’elle travaillait chez ThoughtWorks. Son article fondateur, publié sur le site de ThoughtWorks sous le titre “How to Move Beyond a Monolithic Data Lake to a Distributed Data Mesh”, pose les bases d’un changement profond de paradigme. Elle approfondira ensuite cette vision dans son ouvrage Data Mesh publié chez O’Reilly en 2022.

Le Data Mesh naît d’un constat simple : les architectures centralisées de type Data Lake ou Data Warehouse deviennent des goulots d’étranglement dans les grandes entreprises. Les équipes data centrales accumulent les demandes, la connaissance métier est distante, et la scalabilité organisationnelle devient difficile.

Le Data Mesh repose sur quatre piliers structurants :

L’ambition est claire : distribuer la responsabilité tout en conservant un cadre commun. Sur le plan conceptuel, l’équilibre est élégant.

Le Data Mesh répond à plusieurs problèmes bien identifiés :

Dans des environnements technologiquement matures, certains retours d’expérience positifs sont régulièrement mis en avant dans les conférences spécialisées et publications ThoughtWorks. Les bénéfices théoriques sont significatifs :

Cependant, ces cas restent minoritaires à l’échelle du marché global.

Le facteur le plus souvent sous-estimé est organisationnel.

Le Data Mesh ne consiste pas à déployer une nouvelle architecture technique. Il implique une transformation du modèle opérationnel de l’entreprise. Les départements métiers, y compris ceux historiquement peu techniques comme le marketing ou la finance, doivent intégrer des compétences data structurées, des rôles de data product owner, des responsabilités de qualité et de gouvernance.

Ce changement modifie profondément :

Sans sponsoring exécutif fort et durable, la transformation échoue généralement.

Plusieurs organisations ont expérimenté le Data Mesh avant de revenir vers un modèle centralisé ou hybride. Les causes observées sont récurrentes :

Dans certains cas, les départements préfèrent revenir à une équipe centrale perçue comme plus simple à piloter.

Le paradoxe apparaît alors clairement : un modèle censé réduire la complexité peut en créer davantage s’il est mal calibré.

Le Data Mesh promet la décentralisation. Mais il exige un niveau de discipline supérieur à celui d’un modèle centralisé.

Mal implémenté, il peut conduire à :

La fédération ne fonctionne que si les règles communes sont réellement outillées et appliquées.

Avec l’essor de l’IA, des LLM et des architectures GenAI, le sujet devient encore plus stratégique.

Les systèmes d’IA exigent :

Un Data Mesh mature peut devenir un accélérateur puissant pour les stratégies IA.

Un Data Mesh mal maîtrisé peut au contraire amplifier les risques.

Un déploiement réaliste suppose :

Dans la pratique, de nombreuses organisations convergent vers des modèles hybrides combinant :

Le modèle “pur” est rarement appliqué intégralement.

L’expérience terrain montre qu’une application stricte du modèle théorique est rarement pertinente.

Certaines entreprises ne disposent pas de la maturité organisationnelle nécessaire. D’autres souhaitent limiter les risques et avancer progressivement. Une approche pragmatique consiste à définir une cible stratégique claire tout en déployant par incréments : domaine pilote, cadre de gouvernance testé, montée en compétence progressive.

Dans certains contextes, il est préférable d’adapter les préconisations plutôt que de viser une conformité totale au modèle initial. L’objectif n’est pas l’orthodoxie conceptuelle, mais l’efficacité opérationnelle.

Le Data Mesh n’est ni un mythe ni une solution universelle. C’est un cadre ambitieux, structurant et exigeant.

Sur le papier, la logique est cohérente.

En pratique, la transformation est profonde, culturelle et organisationnelle.

La question clé n’est pas “faut-il adopter le Data Mesh ?”

La question est “quel modèle organisationnel permet réellement de soutenir la stratégie data et IA de l’entreprise sans générer une complexité incontrôlée ?”

Au sein de Axel Douchin Consulting (www.douchinconsulting.com), j’interviens sur ces sujets de structuration data, cloud et IA à l’échelle groupe, en tant que manager de transition et conseiller stratégique.

L’approche consiste à :

L’enjeu n’est pas d’appliquer un modèle théorique.

Il est de construire une organisation data robuste, capable de soutenir durablement la stratégie d’entreprise et les ambitions IA, tout en maîtrisant les risques organisationnels.

Le Data Mesh peut être un levier puissant.

À condition d’être pensé comme une transformation stratégique, et non comme une simple architecture technique.

About the Author

Axel Douchin is a Cloud, Data, and Artificial Intelligence (AI) executive and interim CIO, CTO, and Chief Data Officer specializing in complex digital transformation programs. With more than 20 years of international experience—including leadership roles in global technology initiatives and work with Amazon Web Services—he helps organizations design and execute large-scale cloud migrations, enterprise data strategies, and AI-driven platforms. His work focuses on data governance, scalable cloud architectures, and pragmatic approaches to deploying AI in regulated and high-complexity environments.

Topics: Cloud Strategy · Data Governance · Enterprise Data Platforms · Artificial Intelligence · Digital Transformation

More insights on Cloud, Data, and AI strategy:

www.douchinconsulting.com

Expert analysis on data, cloud, and change management.

Europe can't afford to play catch-up. While others race to 3nm, we should leap directly to 2nm, just like Japan is doing with Rapidus. It’s bold, risky, and exactly what we need. In this article, I argue why Europe should go all-in on 2nm and what it would take to make it happen.

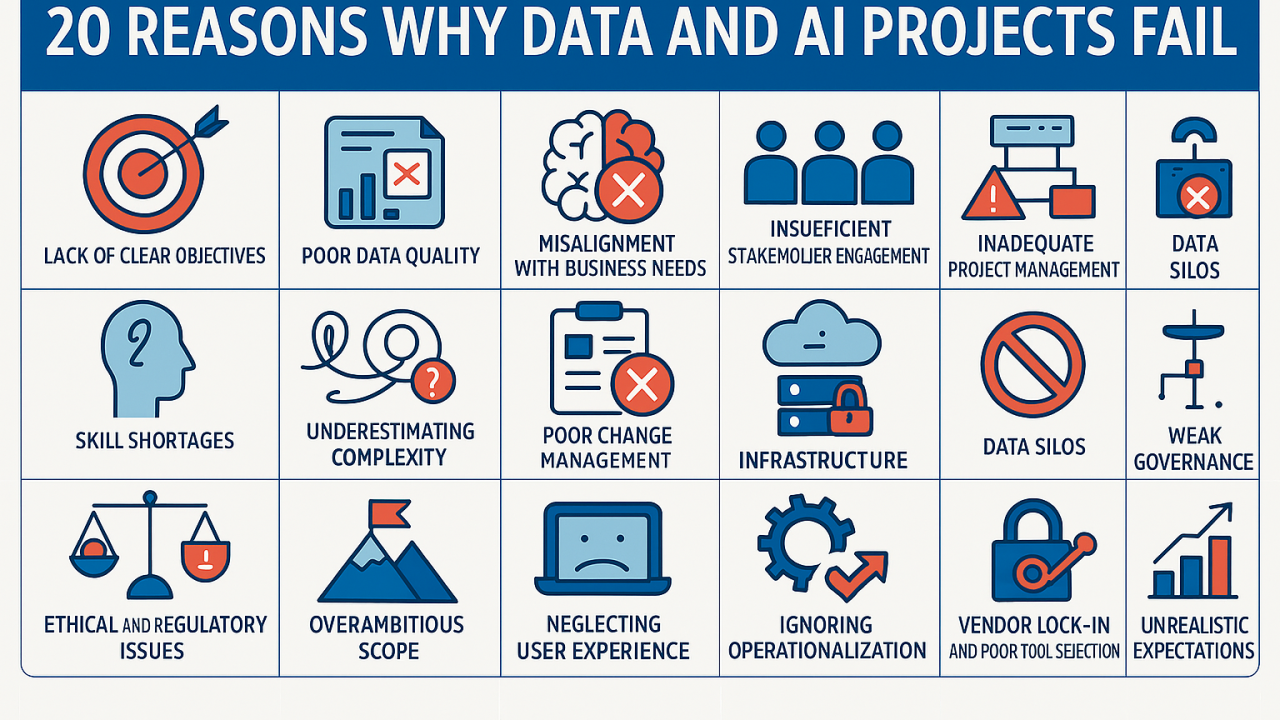

Avoid AI an Data failure, learn from other company's mistakes

Frustration has always been very high with BI solutions. breaking models and dashboards has always been an issue. It often required to prevent end users to create what ever they wanted for governance sake.

Expert guidance for seamless cloud and data transitions. Unlock value, ensure compliance, and lead with confidence.